Test de normalitate

În statistici , testele de normalitate permit verificarea dacă datele reale urmează sau nu o distribuție normală . Testele de normalitate sunt cazuri speciale de test de potrivire (sau de ajustare a testelor , teste pentru compararea distribuțiilor) aplicate unei distribuții normale.

Aceste teste ocupă un loc important în statistici . Într-adevăr, multe teste presupun ca normalitatea distribuțiilor să fie aplicabilă. Strict vorbind, este esențial să se verifice normalitatea înainte de a utiliza testele . Cu toate acestea, multe teste sunt suficient de robuste pentru a putea fi utilizate chiar dacă distribuțiile se abat de la distribuția normală .

Abordări empirice și grafice

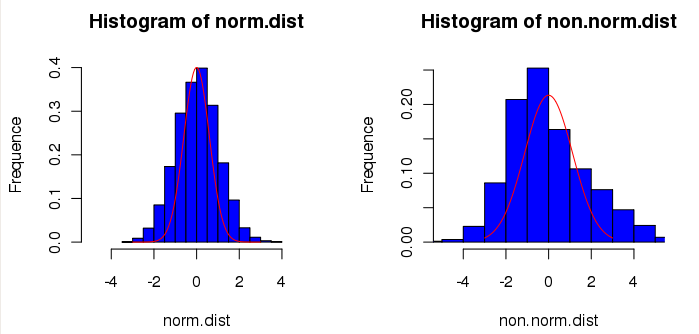

Histograma distribuției

Este posibil să se vizualizeze forma distribuției datelor care urmează să fie analizate reprezentându-le sub forma unei histograme, apoi să se compare forma acestei histograme cu o curbă reprezentând o lege normală (parametrii acestei legi fiind calculați din date de analizat) .analizați). Acest lucru nu concluzionează normalitatea datelor, dar poate da o idee despre tipul legislației de bază: distribuție normală , distribuție Cauchy sau distribuție Student dacă distribuția pare simetrică, lognormală , legea gamma , legea Weibull , legea exponențială sau legea beta dacă distribuția este asimetrică.

Histograma reziduurilor

De asemenea , este posibil să se reprezinte histograma a reziduurilor (adică diferența dintre distribuția observată și distribuția normală). Reziduurile trebuie să urmeze, de asemenea, o distribuție normală.

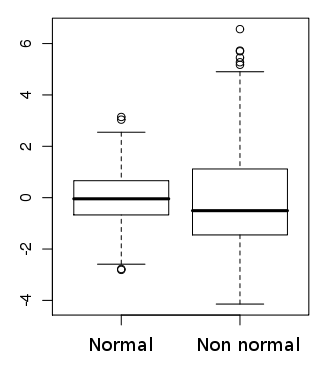

Complot cutie

Un boxplot face posibilă vizualizarea rapidă a simetriei distribuției datelor reale și a prezenței valorilor aberante.

Grafic cuantil-cuantil (grafic qq)

Coeficienți de asimetrie și kurtoză

Coeficienții de asimetrie și kurtoză sunt de asemenea utili pentru definirea unei distribuții normale.

Pentru turtire:

și pentru asimetrie:

unde este rădăcina unui estimator al varianței imparțiale.

Știm de fapt că coeficientul de asimetrie este egal cu zero pentru orice lege normală, în timp ce coeficientul de aplatizare este egal cu 3 (0 dacă este normalizat)

Abordare probabilistică

Există, de asemenea, un număr mare de teste de normalitate:

- Teste bazate pe funcția de distribuție empirică : testul Kolmogorov-Smirnov și adaptarea acestuia testul Lilliefors sau testul Anderson-Darling și testul Cramer-Von Mises

- Testele se bazează pe timpuri , cum ar fi testul Jarque-Bera sau Test D'Agostino .

- sau testul Shapiro-Wilk sau testul Shapiro - Francia .

Un articol din Journal of Statistical Modeling and Analytics din 2011 concluzionează că Shapiro-Wilk are cea mai bună potență pentru un anumit nivel de semnificație, urmat îndeaproape de Anderson-Darling, comparând testele lui Shapiro-Wilk, Kolmogorov-Smirnov, Lilliefors și Anderson-Darling.

General

Testele de normalitate sunt teste de ipoteză . Prin notând funcția de distribuție pe baza datelor care urmează să fie analizate și teoretic funcția de distribuție , nule și alternative ipoteze pot fi scrise:

.

Testele pe momente au o presupunere mai slabă, nu testează dacă funcția de distribuție este normală, dar dacă momentele (asimetria și coeficienții de curtoză) ale distribuției necunoscute sunt identice cu cele ale unei distribuții normale:

Rețineți că acest lucru nu este suficient pentru a caracteriza o lege normală ( problema momentului ).

Test² test de adecvare

Utilizarea sa nu este recomandată din cauza lipsei de putere și a necesității de a împărți distribuțiile în clase.

Testele bayesiene

Aplicații

O aplicație a testelor de normalitate se referă la reziduurile unui model de regresie liniară. Dacă nu sunt distribuite în mod normal, reziduurile nu pot fi utilizate în testele Z sau în orice alt test, atâta timp cât implică presupuneri de normalitate (de exemplu, testul t , testul Fisher sau testul χ² ). Dacă reziduurile nu sunt distribuite în mod normal, înseamnă că variabila dependentă sau cel puțin o variabilă explicativă ar putea avea o funcție de distribuție eronată; variabile importante pot lipsi, de asemenea. Una sau mai multe corecții ale acestor erori clasice pot duce la reziduuri care urmează o distribuție normală.

Vezi și tu

- Gilbert Saporta , Probabilitate, Analiza datelor și statistici , Paris, Éditions Technip,2006, 622 p. [ detaliu ediții ] ( ISBN 978-2-7108-0814-5 , prezentare online )( pp. 359-370).

- Judge și colab., Introducere în teoria și practica econometriei, ediția a doua , 1988; 890–892.

- Gujarati, Damodar N., Econometrie de bază, ediția a patra , 2003; 147–148

Referințe

- Razali, Nornadiah; Wah, Yap Bee (2011). „Comparații de putere ale testelor Shapiro-Wilk, Kolmogorov-Smirnov, Lilliefors și Anderson-Darling”. Journal of Statistical Modeling and Analytics 2 (1): 21–33.

- Judge și colab. (1988) și Gujarati (2003) recomandă testul Jarque - Bera.